一旦名为“copainter”的AI上色服务发布,我想我就不会再自己使用Stable Diffusion进行上色了(因为太麻烦了)。不过,确实有一个很好的ControlNet模型发布了,所以我想介绍一下。

本文预期的环境

webUI: a1111 或 forge

模型:SDXL系列(在稍后的生成示例中,我使用了Animagine XL 3.1)

这是为已经搭建好环境的用户提供的简单说明。

使用的ControlNet模型

这就是在开头提到的“非常好的ControlNet模型”。

Katarag_lineartXL-fp16.safetensors

这是Kataragi的lineart。目前,这个模型在SDXL系列lineart中似乎是最精确的。

请自行搜索ControlNet模型的下载方法和保存位置。

用Stable Diffusion为我的自作线稿上色的方法

我们将使用ControlNet线稿与i2i。

i2i设置

选择i2i标签,并在“将图像拖到此处 – 或 – 单击上传”区域输入图像。

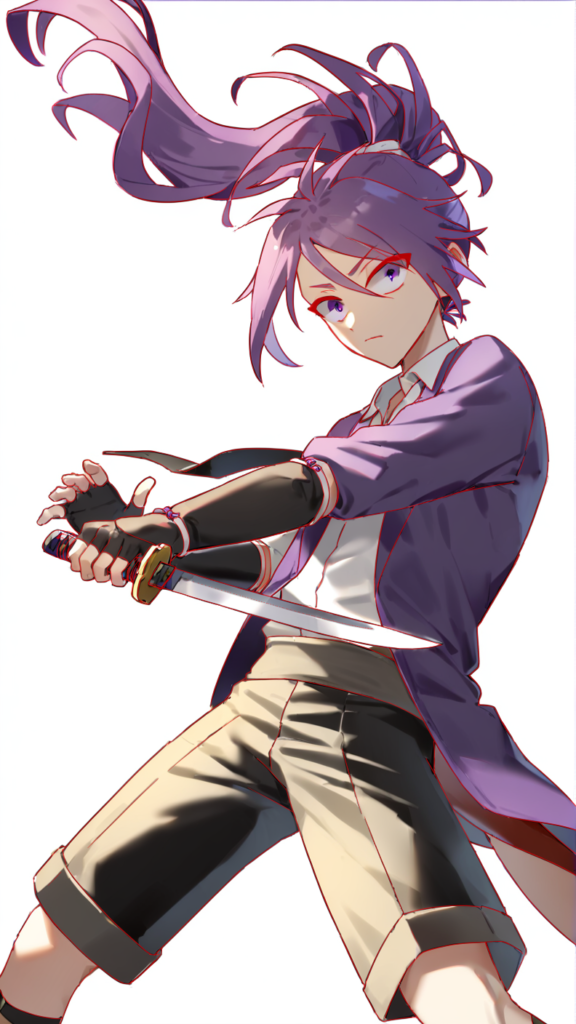

作为示例,我输入了这张图片。在i2i中指定参考图像后,可以使用“Interrogate CLIP”或“Interrogate DeepBooru”输入提示。(当然,如果你不觉得麻烦,也可以自己输入。)

如果有多余的提示,请删除,并添加想要的内容。

在生成图像大小的部分点击三角尺图标,以获取原始图像的大小(如果你想以与原始图像相同的大小生成)。

将Denoising Strength设置为你选择的值。我认为0.5到0.75左右比较合适。

ControlNet设置

指定用于lineart的图像。

这次,我输入了这幅线稿。即使不输入任何内容,也可以通过preprocesser从i2i参考图像生成线稿,但如果你有自己的线稿,输入自作线稿会更忠实于线稿。

选择“invert(from white bg & black line)”作为preprocesser。

选择模型Katarag_lineartXL-fp16.safetensors。

其他数值无需更改。请尝试生成。

生成结果

叠加的线稿

这是将线稿叠加在生成物上的图像。线稿以70%的红色叠加。

Denoising Strength 0.5

我觉得在SD1.5系列中,即使是0.5,阴影也会更多,但这次画得有点淡。

Denoising Strength 0.65

就个人而言,我认为在我尝试的中,这个0.65的设置是最好的。阴影和光线都表现得不错,整体效果提升,同时也保留了原色的不错比例。

Denoising Strength 0.75

虽然0.75产生的作品是最好的,但颜色变化挺大的。由于在制作底色时我将图层按部件分开,所以生成后可以利用这些图层调整颜色。

我无法尝试的事情

实际上,在使用SD1.5系列进行上色时,我同时使用了lineart和tile。使用tile可以更好地保持颜色,让我能够提高去噪强度的数值,达到不错的效果。不过,这次我尝试这样做时遇到了错误,无法进行。

最近在我的环境中频繁出现错误,我也不知道哪里出了问题。如果有人成功一起使用tile,能告诉我结果如何,我会很感激。

真是了不起的lineart!

我对开发者感到抱歉,但SDXL系列在ControlNet的精度上一直表现不佳。作为一名艺术家,我希望AI能够与我的作品匹配,但这一直没能实现。然而,突然间这个模型的测试版发布了,不久之后Katarag_lineartXL也上线了。我原本以为“上色已经是copainter的独角戏了!”没想到会有如此高精度的模型公开发布。我真的希望图像生成AI能被艺术家们使用,所以看到这样对艺术家有帮助的模型被公开我非常开心。谢谢!

结束

顺便说一下…这是关于copainter的链接。

对于那些觉得本地环境有些困难的人,我推荐copainter。它不仅提供上色功能,还有描线和其他功能。

本地环境可以无限使用,而且可以进行精细调整,这是它的一大优点。

2024/12/29: 添加了介绍copainter的文章链接。