この記事は「アーカイブ」カテゴリに分類されています。現在では状況が変わっているレベルで情報が古いです。ご注意ください。

前置き

しばらく前にtileの実験をしていて「プリプロセッサがよくわからん!」と思って放置していました。ところがプリプロセッサはnoneでいけることを知ったので、その確認がてら昔の絵をi2iしてみました。

この i2i は絶対に他人の絵でやらないでください。元画像に依拠性も類似性もバリバリあるので、訴えられたら著作権侵害になるはずです。自分の絵など、使っても問題のない画像でやってください。

著作権について勉強したい方はこちら↓がおすすめです。

令和5年度著作権セミナー「AIと著作権」の講演映像及び講演資料

i2i元(10年前に描いた絵)

バトルスピリッツ ソードアイズというアニメの二次創作です。

・衣装が再現できるか

・目が大きすぎるのが、どの程度修正されるか

・テクスチャを貼ってるけど大丈夫かな

…あたりが気になりつつi2iしました。

生成時の設定

プロンプト

2boys, black eyes, black hair, blue coat, boots, brown hair, cape, clenched hand, closed eyes, coat, full body, gloves, grin, male focus, multiple boys, pants, red shirt, shirt, smile, spiked hair, white pants <lora:flat2:-0.2>

Negative prompt: (worst quality, low quality:1.4)プロンプトはDeepBooruで元絵を解析したものです。それに<lora:flat2:-0.2>だけ付け足しました。

i2i の設定

Steps: 25,

Sampler: DPM++ 2M SDE Karras,

CFG scale: 7,

Seed: 4074491323,

Size: 1227x1227,

Model hash: 3a105af1a6,

Model: blue_pencil-v10,

Denoising strength: 0.45,

Clip skip: 2, 元絵のサイズは 818×818 です。1.5倍にアプスケしたので 1227×1227 になってます。

モデルが blue_pencil-v10 になってますが、Counterfeit V3.0 も使いました。

Denoising は、AIっぽくしたいけど色は維持してほしかったので 0.45 にしました。

Tiled Diffusion の設定

Tiled Diffusion upscaler: R-ESRGAN 4x+ Anime6B,

Tiled Diffusion scale factor: 1.5,

Tiled Diffusion: {"Method": "Mixture of Diffusers", "Tile tile width": 96, "Tile tile height": 96, "Tile Overlap": 16, "Tile batch size": 4, "Upscaler": "R-ESRGAN 4x+ Anime6B", "Upscale factor": 1.5, "Keep input size": true}, デフォルトから変更したのは、メソッド、オーバーラップ、アップスケーラー、スケール、のみです。

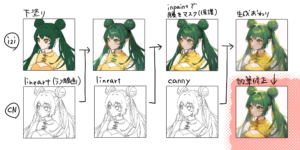

コントロールネットの設定

マルチコントロールネットで2種類かけています。どちらも画像は入力していません。

ControlNet 0:

"Module: none,

Model: control_v11f1e_sd15_tile_fp16 [3b860298],

Weight: 1,

Resize Mode: Crop and Resize,

Low Vram: False,

Guidance Start: 0,

Guidance End: 1,

Pixel Perfect: False,

Control Mode: Balanced", ひとつめは Tile。プリプロセッサーを none にした以外はデフォルト値です。

ControlNet 1:

"Module: lineart_anime,

Model: control_v11p_sd15s2_lineart_anime_fp16 [c58f338b],

Weight: 1,

Resize Mode: Crop and Resize,

Low Vram: False,

Processor Res: 512,

Guidance Start: 0,

Guidance End: 0.2,

Pixel Perfect: False,

Control Mode: Balanced", ふたつめは Lineart。プリプロセッサもモデルも anime にしました。

Guidance End を 0.2 にしました。(上手くなって欲しいから)

他

Lora hashes: flat2: 80f764dfb478,

Version: v1.3.0flat2 LoRA を使用しました。webUI のバージョンは v1.3.0 です。(SD1.5 しか使わないなら v1.3.0 が安定と見かけたので)

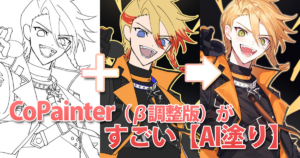

生成された絵

モデルによってどの程度差が出るか気になったので2種類やってみました。見た感じはそんなに変わらないんですが、加筆するときは blue pencil の方がやりやすかったです。

衣装が再現できるか

ボタンの形が違ったり、ベルトがぐちゃってたり、ブーツの構造が変わったり、細部はちょっと気になりましたが概ね再現できてるように思いました。加筆修正しようかなという気が起こるくらい。(ちょっとで済みそうの意)

気になったのは、向かって左側、白い服のキャラが服を掴んでるように解釈されてしまってることですね。しわが…。でもこれはどうしようもなさそうに思ったのでスルーしました。

目が大きすぎるのが、どの程度修正されるか

元の絵は自分で見ても大きすぎるので、少し小さくなってて良かったです。モデルの絵よりは大きいので、lineartが効いてると思います。

テクスチャを貼ってるけど大丈夫かな

denoising 0.45 なので大丈夫なんですが、0.3 だとちょっとウニャウニャした感じが出てました。

加筆修正したものと元絵の比較

この雑な枠は lineart を外して tile のみにしたら、もうすこしマシな感じになるんですが、合成するのが面倒で雑なままです。lineart は元絵の維持力が強いので助かるんですが、雑な部分は雑なまま維持してくれるので使い方は考えた方がいいって感じです。

かかった時間は、i2i をしてたのが1時間くらい、加筆修正が1時間くらいで、合計約2時間でした。i2i は次からもっと速くできると思います~。

かなり昔に描いたので、何を考えながら描いたのか覚えて無くて、そのせいで「コレジャナイ!」とあまりならなかったです。(いつもはなりがち)

i2i で昔の絵をサルベージするのはけっこういいかもしれないと思いました。

おわり。